你有没有想过,那些在网络上帮你解答问题的智能助手,其实背后有着庞大的“大脑”?没错,就是那些开源的AI大模型!今天,就让我带你一探究竟,揭开这些神秘模型的神秘面纱。

什么是开源的AI大模型?

首先,得弄明白什么是AI大模型。简单来说,AI大模型就是通过海量数据训练出来的,能够执行复杂任务的智能系统。而“开源”的意思,就是这些模型的源代码是公开的,任何人都可以查看、修改和分发。

那么,开源的AI大模型有什么特别之处呢?首先,它们能够处理各种复杂任务,比如语言翻译、图像识别、语音识别等。其次,开源意味着更多的开发者可以参与到模型的改进和优化中,从而推动整个AI技术的发展。

开源AI大模型的发展历程

说起开源AI大模型的发展,不得不提的是谷歌的TensorFlow和Facebook的PyTorch。这两个框架的出现,极大地推动了AI大模型的发展。

2015年,谷歌发布了TensorFlow,这是一个基于数据流编程的端到端开源机器学习平台。随后,PyTorch在2016年诞生,它以动态计算图和易于使用的API赢得了众多开发者的喜爱。

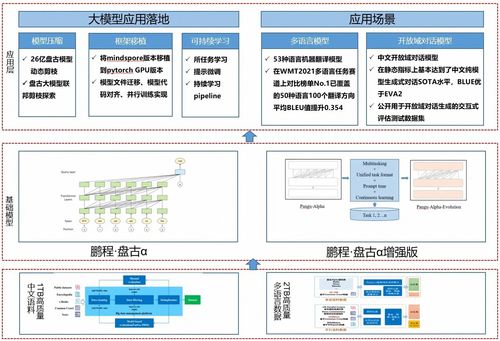

随着时间的推移,越来越多的开源AI大模型涌现出来,比如Hugging Face的Transformers、华为的MindSpore等。这些模型在各自的领域都取得了显著的成果。

开源AI大模型的应用场景

开源AI大模型的应用场景非常广泛,几乎涵盖了生活的方方面面。

在语言处理领域,开源AI大模型可以用于机器翻译、文本摘要、情感分析等。比如,谷歌的BERT模型在机器翻译方面取得了突破性的成果,使得翻译质量得到了显著提升。

在计算机视觉领域,开源AI大模型可以用于图像识别、目标检测、人脸识别等。比如,OpenCV是一个开源的计算机视觉库,它提供了丰富的图像处理和计算机视觉算法。

在语音识别领域,开源AI大模型可以用于语音合成、语音识别、语音搜索等。比如,科大讯飞的开源语音识别模型ASR,在语音识别领域取得了优异的成绩。

开源AI大模型的挑战与机遇

尽管开源AI大模型在各个领域都取得了显著的成果,但它们也面临着一些挑战。

首先,开源AI大模型的训练需要大量的计算资源和数据,这对于普通用户来说可能是一个难题。其次,开源AI大模型的性能和稳定性还有待提高,尤其是在面对复杂任务时。

这些挑战也带来了机遇。随着技术的不断发展,开源AI大模型将会越来越容易使用,性能也会得到进一步提升。同时,更多的开发者参与到开源AI大模型的开发中,将推动整个AI技术的进步。

开源的AI大模型,就像一颗璀璨的明珠,照亮了人工智能的发展之路。它们不仅推动了技术的进步,还让更多的人能够享受到AI带来的便利。未来,随着开源AI大模型的不断发展,我们期待看到更多令人惊叹的应用场景出现。